ChatGPT č un modello di linguaggio basato su GPT-3 sviluppato da OpenAI che sta facendo parlare molto di sé in questo periodo. E' stato progettato per generare risposte coerenti e realistiche in una conversazione e consente agli sviluppatori di integrare facilmente il modello per creare una conversazione secondo le indicazioni e i dati forniti.

Oltre a ChatGPT, OpenAI fornisce altri modelli che si possono utilizzare attraverso un profilo sviluppatore, ma in questo articolo vogliamo invece presentare come possiamo utilizzare OpenAI sulla piattaforma Microsoft Azure. Il vantaggio che ne traiamo, oltre a quelli amministrativi e di pagamento, č quello di sfruttare un ambiente che giŕ conosciamo, fatto di documentazione, strumenti ed esempi, il tutto integrato nell'ecosistema Azure. Questo significa poter piů facilmente integrare il modello con gli altri servizi, il supporto alle reti private, l'integrazione con il managed identity e la scelta di differenti regioni.

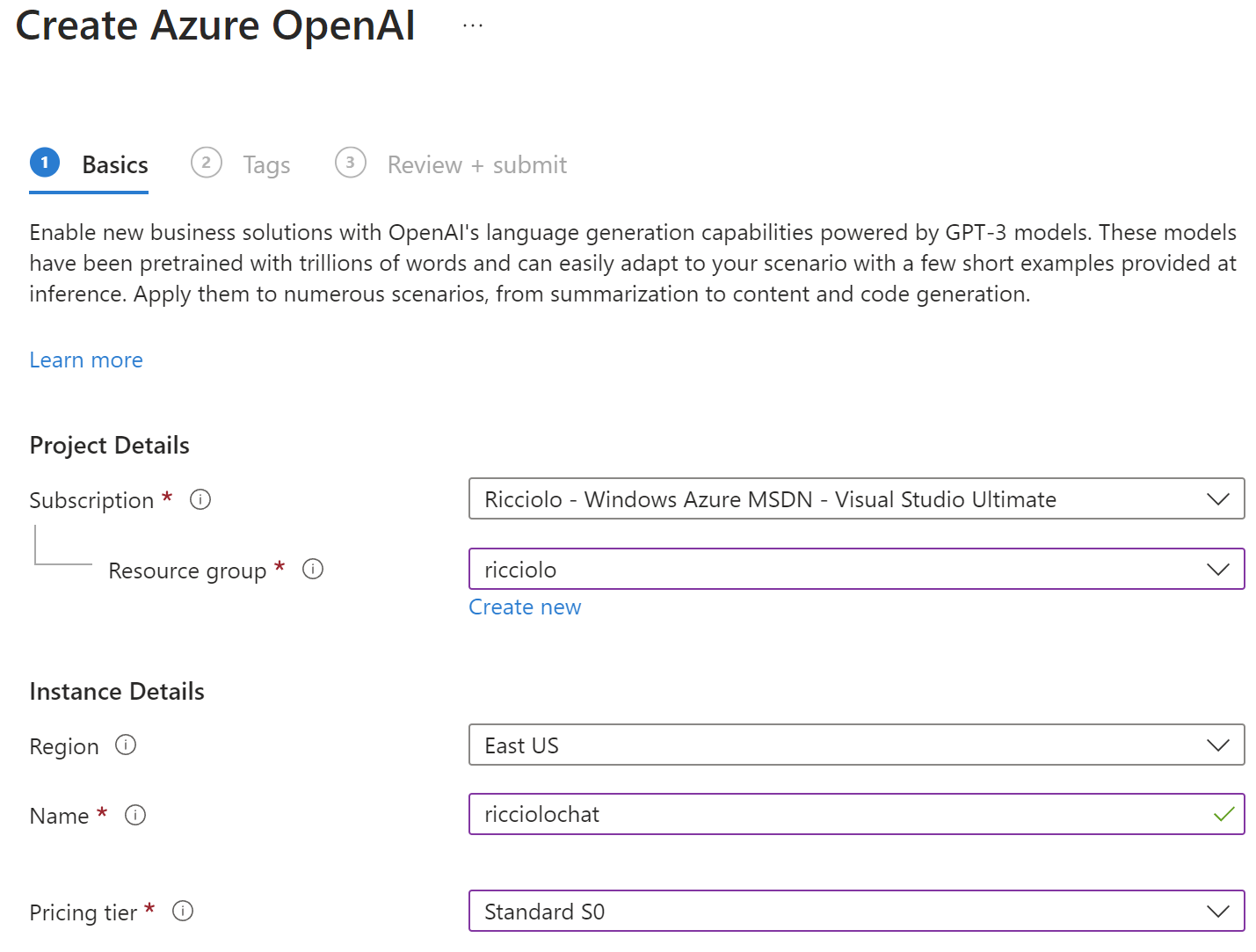

Per poter utilizzare ChatGPT dobbiamo prima di tutto compilare un questionario https://aka.ms/oaiapply che nel giro di qualche giorno ci permetterŕ di creare il servizio su Azure. Sempre dal portale possiamo creare una nuovo account OpenAI, come mostrato nella figura. Attenzione a scegliere per ora East US perché ChatGPT č disponibile per il momento solo in quella regione.

Creato l'account si presenta la solita maschera che principalmente presenta il pulsante Go to Azure OpenAI Studio, il quale apre un nuovo sito che presenta una serie di guide e documenti, e direttamente il Chat playground, cioč la possibilitŕ di provare la conversazione.

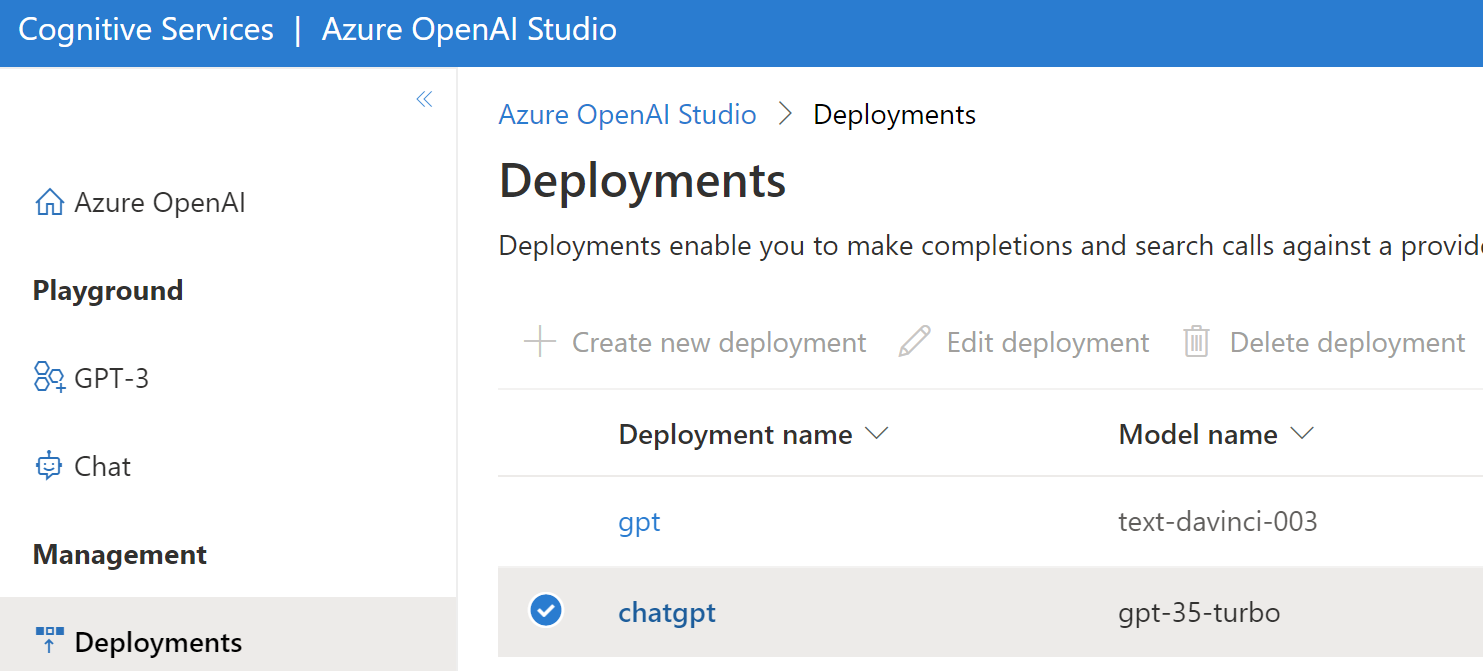

Prima di procedere, perň, dobbiamo prima di tutto effettuare il deploy di un modello, accedendo alla sezione Deployments. Creiamo un nuovo deployment di tipo gpt-35-turbo con il nome che vogliamo, per poterlo identificare.

Premiamo finalmente su Chat per aprire una pagina dove possiamo da una parte dare indicazioni al motore, su come deve comportarsi e come deve interagire. Troviamo anche degli esempi per capire come approcciare. Sul lato destro troviamo, invece, la possibilitŕ di conversare.

Lo scopo ultimo č quello di poter vedere il codice, usando la libreria Python oppure con delle semplici chiamate HTTP che ci permetta poi di utilizzarlo nei nostri applicativi.

Per maggiori approfondimenti rimandiamo alla pagina documentazione ufficiale https://learn.microsoft.com/en-us/azure/cognitive-services/openai/

Commenti

Per inserire un commento, devi avere un account.

Fai il login e torna a questa pagina, oppure registrati alla nostra community.

Approfondimenti

Utilizzare DeepSeek R1 con Azure AI

Migliorare l'organizzazione delle risorse con Azure Policy

Generare HTML a runtime a partire da un componente Razor in ASP.NET Core

Aggiornare a .NET 9 su Azure App Service

Gestione degli stili CSS con le regole @layer

Introduzione ai web component HTML

Loggare le query più lente con Entity Framework

.NET Conference Italia 2024

Utilizzare Azure Cosmos DB con i vettori

Cancellare una run di un workflow di GitHub

Proteggere le risorse Azure con private link e private endpoints

Introduzione alle Container Queries